Command Palette

Search for a command to run...

Paul-Edouard Sarlin Daniel DeTone Tomasz Malisiewicz Andrew Rabinovich

摘要

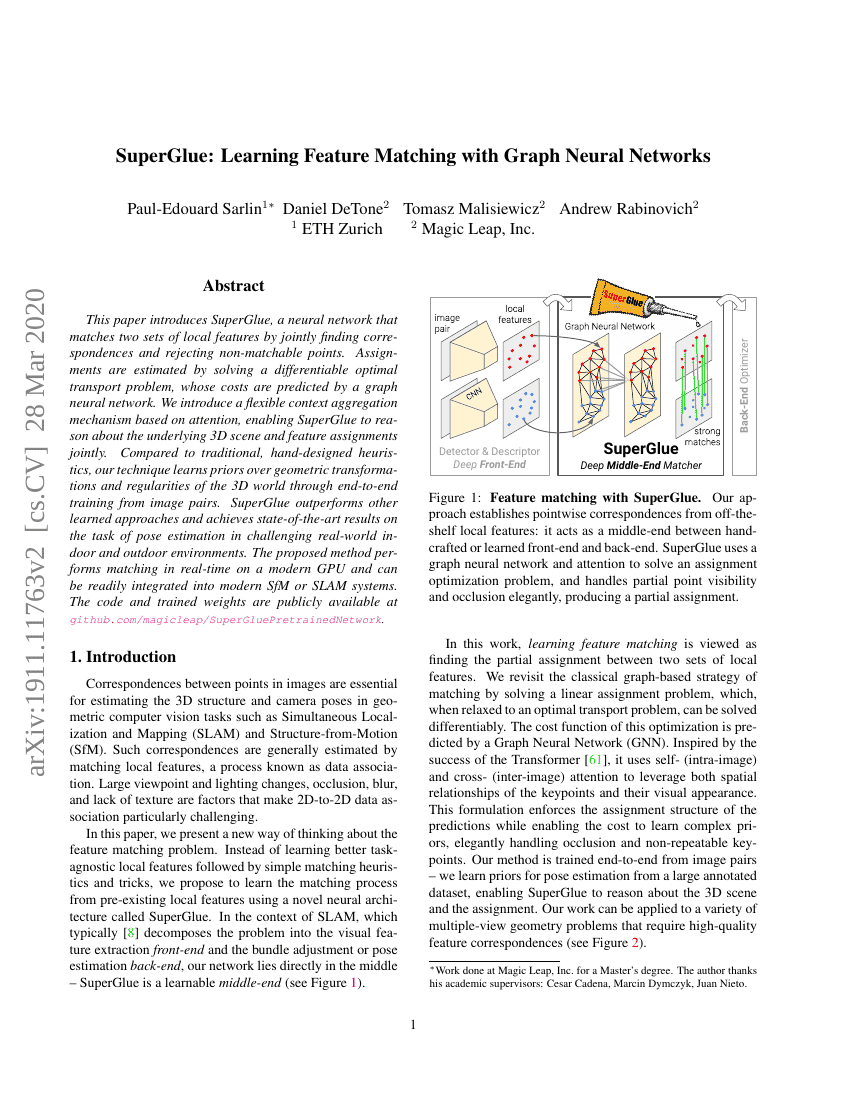

本文介绍了SuperGlue,一种通过联合寻找对应关系和拒绝不可匹配点来匹配两组局部特征的神经网络。匹配关系是通过求解一个可微分的最优传输问题来估计的,该问题的成本由图神经网络预测。我们引入了一种基于注意力机制的灵活上下文聚合方法,使SuperGlue能够同时推断出底层3D场景和特征匹配关系。与传统的手工设计启发式方法相比,我们的技术通过从图像对中进行端到端训练,学习了几何变换和3D世界规律性的先验知识。SuperGlue在具有挑战性的实际室内和室外环境中,其姿态估计任务上的表现优于其他学习方法,并达到了最先进的水平。该方法在现代GPU上可以实现实时匹配,并且可以轻松集成到现代SfM(结构从运动)或SLAM(同时定位与地图构建)系统中。代码和预训练权重已公开发布在https://github.com/magicleap/SuperGluePretrainedNetwork。

代码仓库

基准测试

| 基准 | 方法 | 指标 |

|---|---|---|

| image-matching-on-imc-phototourism | SuperGlue | mean average accuracy @ 10: 0.65248 |

| image-matching-on-zeb | SuperGlue | Mean AUC@5°: 31.2 |

| pose-estimation-on-inloc | SuperGlue | [email protected],10°: 49.0 [email protected],10°: 68.7 [email protected],10°: 80.8 [email protected],10°: 53.4 [email protected],10°: 77.1 [email protected],10°: 82.4 |

| visual-localization-on-aachen-day-night-v1-1 | SuperGlue | |

| visual-place-recognition-on-berlin-kudamm | SuperPoint & SuperGlue | Recall@1: 59.64 |