Command Palette

Search for a command to run...

Shoufa Chen Enze Xie Chongjian Ge Runjian Chen Ding Liang Ping Luo

摘要

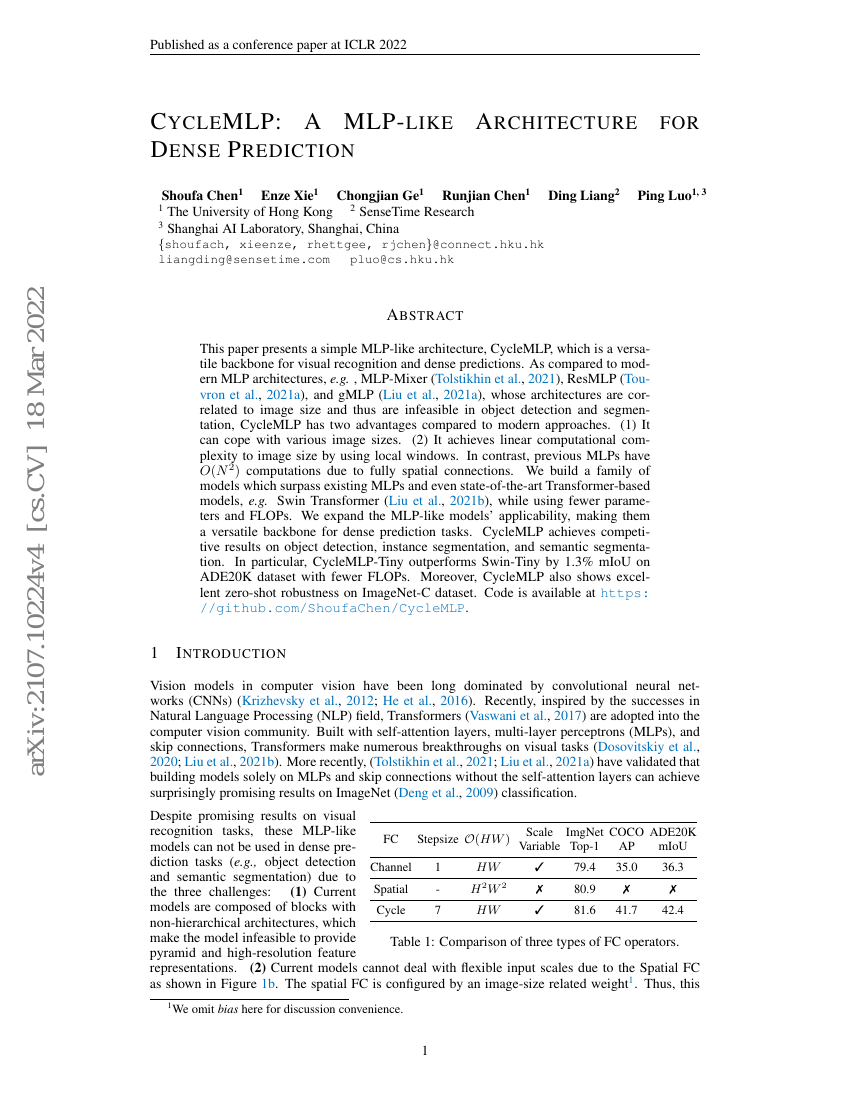

本文提出了一种类似多层感知机(MLP)的简洁架构——CycleMLP,其可作为视觉识别与密集预测任务的通用主干网络。相较于当前主流的MLP架构(如MLP-Mixer、ResMLP和gMLP),这些架构的结构与图像尺寸紧密相关,因而难以应用于目标检测与图像分割等任务,CycleMLP具备两大优势:(1)能够处理多种尺寸的输入图像;(2)通过引入局部窗口机制,实现了计算复杂度与图像尺寸呈线性关系,而传统MLP由于存在全空间连接,其计算复杂度为O(N2)。基于此,我们构建了一系列模型,其性能超越了现有各类MLP模型,甚至在参数量和浮点运算量(FLOPs)更少的情况下,优于当前先进的基于Transformer的模型(如Swin Transformer)。本工作显著拓展了类MLP模型的应用范围,使其成为密集预测任务中具有高度通用性的主干网络。CycleMLP在目标检测、实例分割和语义分割任务上均取得了具有竞争力的性能表现。特别地,在ADE20K数据集上,CycleMLP-Tiny模型以更低的FLOPs实现了比Swin-Tiny高出1.3%的mIoU指标。此外,CycleMLP在ImageNet-C数据集上还展现出优异的零样本鲁棒性。代码已开源,地址为:https://github.com/ShoufaChen/CycleMLP。

代码仓库

基准测试

| 基准 | 方法 | 指标 |

|---|---|---|

| image-classification-on-imagenet | CycleMLP-B5 | GFLOPs: 12.3 Number of params: 76M Top 1 Accuracy: 83.2% |

| semantic-segmentation-on-densepass | CycleMLP (MiT-B1) | mIoU: 40.16% |