Command Palette

Search for a command to run...

Zuhao Yang Sudong Wang Kaichen Zhang Keming Wu Sicong Leng Yifan Zhang Chengwei Qin Shijian Lu Xingxuan Li Lidong Bing

摘要

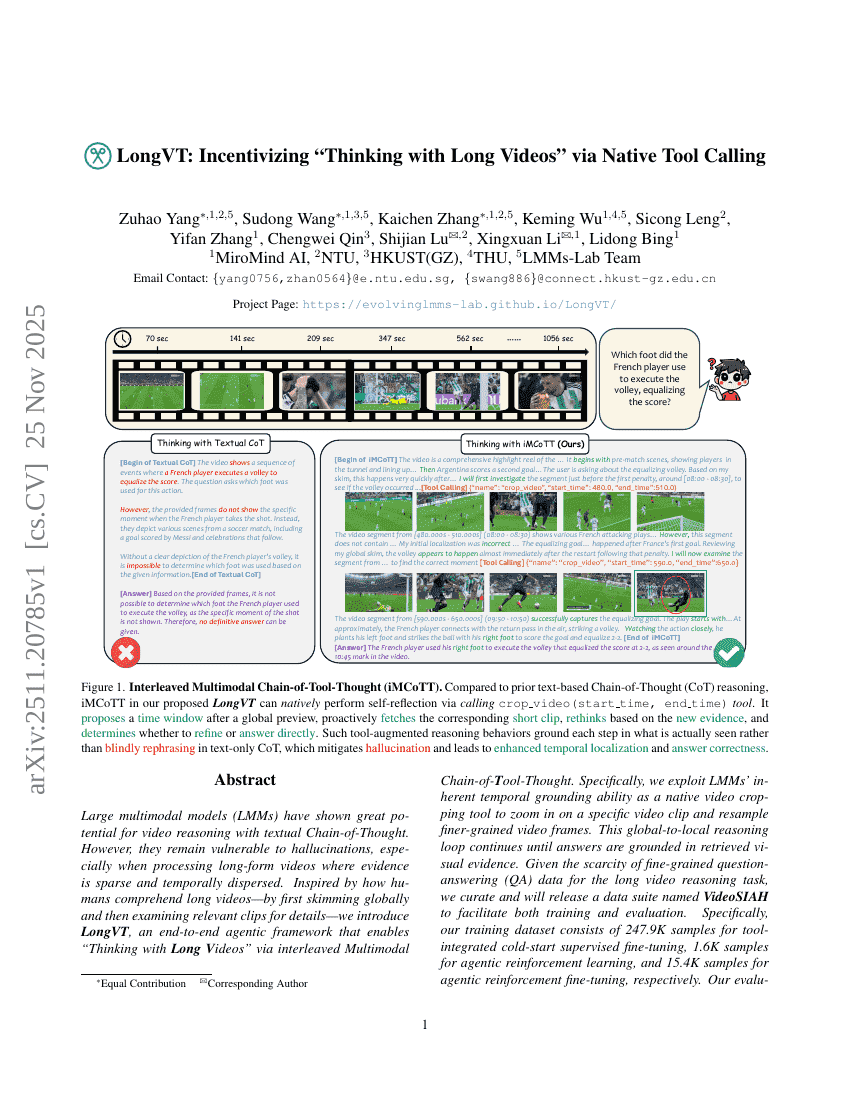

大型多模态模型(LMMs)在结合文本思维链(Chain-of-Thought)进行视频推理方面展现出巨大潜力。然而,当处理长时长视频时,由于证据稀疏且在时间上分布分散,这些模型仍容易产生幻觉。受人类理解长视频方式的启发——即先进行全局概览,再聚焦于相关片段进行细节分析——我们提出 LongVT,一个端到端的智能体式框架,通过交错执行的多模态“工具-思维链”(Multimodal Chain-of-Tool-Thought),实现“对长视频的深度思考”。具体而言,我们利用 LMMs 本身固有的时间定位能力,将其作为原生的视频裁剪工具,精准聚焦于特定视频片段,并对视频帧进行更细粒度的重采样。这一“全局到局部”的推理循环持续进行,直至最终答案能够基于检索到的视觉证据进行可靠支撑。鉴于当前长视频推理任务中细粒度问答(QA)数据的稀缺性,我们构建并公开发布了一个名为 VideoSIAH 的数据集,以支持模型的训练与评估。该数据集包含三类样本:用于工具融合的冷启动监督微调的 247.9 万条样本,用于智能体强化学习的 1.6 千条样本,以及用于智能体强化微调的 15.4 千条样本。评估基准则包含 1,280 组精心构建的问答对,通过半自动数据流水线结合人工在环(human-in-the-loop)验证流程进行严格筛选。在精心设计的三阶段训练策略和充分的实证验证下,LongVT 在四个具有挑战性的长视频理解与推理基准上,持续超越现有主流基线模型。相关代码、数据集及模型检查点已公开发布于:https://github.com/EvolvingLMMs-Lab/LongVT。