Command Palette

Search for a command to run...

Jiangtao Wu Shihao Li Zhaozhou Bian Yuanxing Zhang Jialu Chen Runzhe Wen An Ping Yiwen He Jiakai Wang Jiaheng Liu

摘要

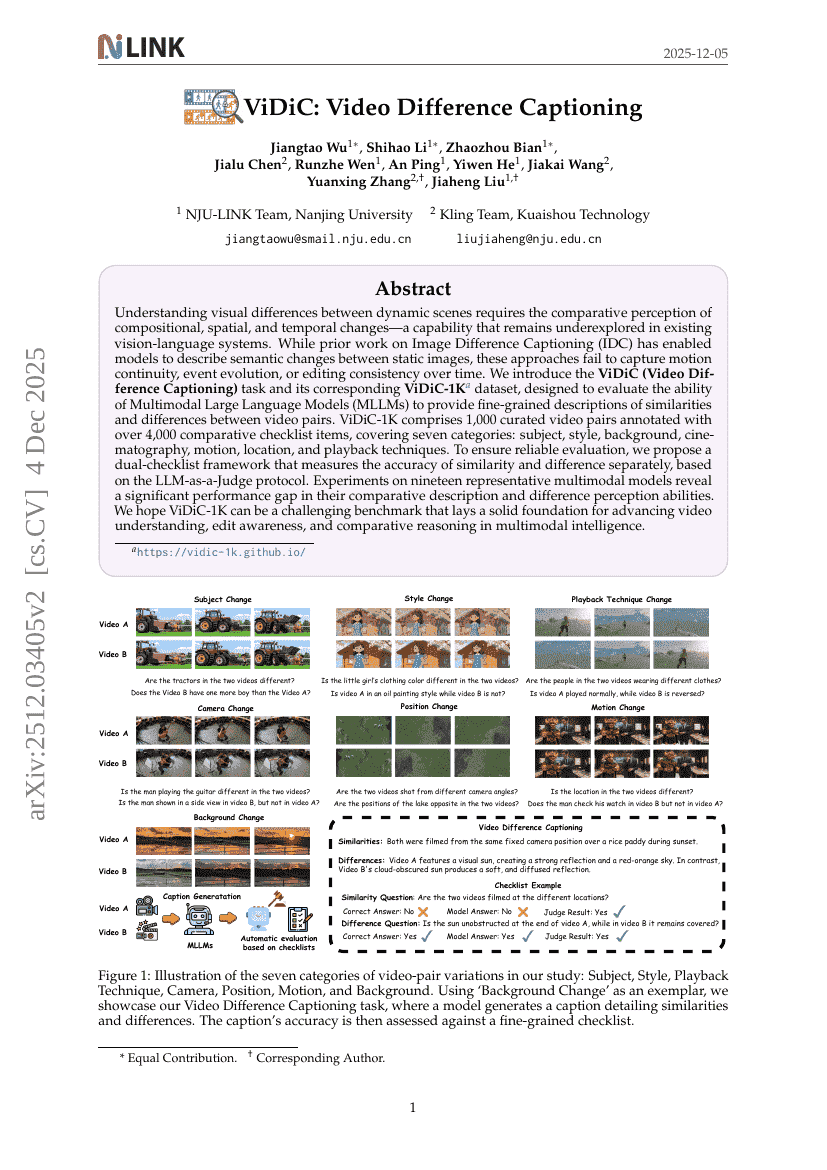

理解动态场景之间的视觉差异,需要对构图、空间和时间变化进行对比感知——这一能力在现有视觉-语言系统中仍处于未充分探索的状态。尽管此前在图像差异描述(Image Difference Captioning, IDC)方面的研究已使模型能够描述静态图像之间的语义变化,但这些方法难以捕捉运动的连续性、事件的演化过程或编辑的一致性等时间维度上的关键特征。为此,我们提出了视频差异描述(Video Difference Captioning, ViDiC)任务,并构建了相应的ViDiC-1K数据集,旨在评估多模态大语言模型(Multimodal Large Language Models, MLLMs)对视频对之间相似性与差异性的细粒度描述能力。ViDiC-1K包含1,000组精心筛选的视频对,配有超过4,000项对比检查项,涵盖七个类别:主体、风格、背景、摄影手法、运动、场景位置以及播放技术。为确保评估的可靠性,我们提出一种双检查项框架,基于“大语言模型作为评判者”(LLM-as-a-Judge)的协议,分别衡量模型在相似性与差异性判断上的准确性。在19个代表性多模态模型上的实验表明,这些模型在对比描述与差异感知能力方面存在显著性能差距。我们期望ViDiC-1K能够成为一个具有挑战性的基准,为推动视频理解、编辑意识以及多模态智能中的对比推理能力发展奠定坚实基础。