Command Palette

Search for a command to run...

Supertonic:基于 ONNX 的极速 TTS 语音合成模型

一、教程简介

本教程基于 Supertone 官方开源项目「Supertonic」,感谢 Supertone 团队对开源社区的贡献 ❤️!

Supertonic 是 Supertone 团队于 2025 年 1 月推出的本地文本转语音引擎(Text to Speech, TTS)。其核心推理端采用 ONNX Runtime 实现,专为低延迟和高并发场景设计。与传统的大型 TTS 模型不同,Supertonic 在保持高质量语音合成的同时,极大地降低了硬件门槛,支持在桌面端、服务器甚至边缘设备上进行完全离线的实时推理。它特别适合对隐私安全有要求,或需要集成到实时交互应用(如数字人、游戏语音)中的场景。

请注意:本项目目前仅支持英文文本的语音合成。

本教程在 OpenBayes 平台上,以「单卡 RTX 5090」作为演示算力资源,配合 onnxruntime-gpu 硬件加速,使用 Gradio 搭建了一个可视化网页界面,实现毫秒级的英文语音合成体验。

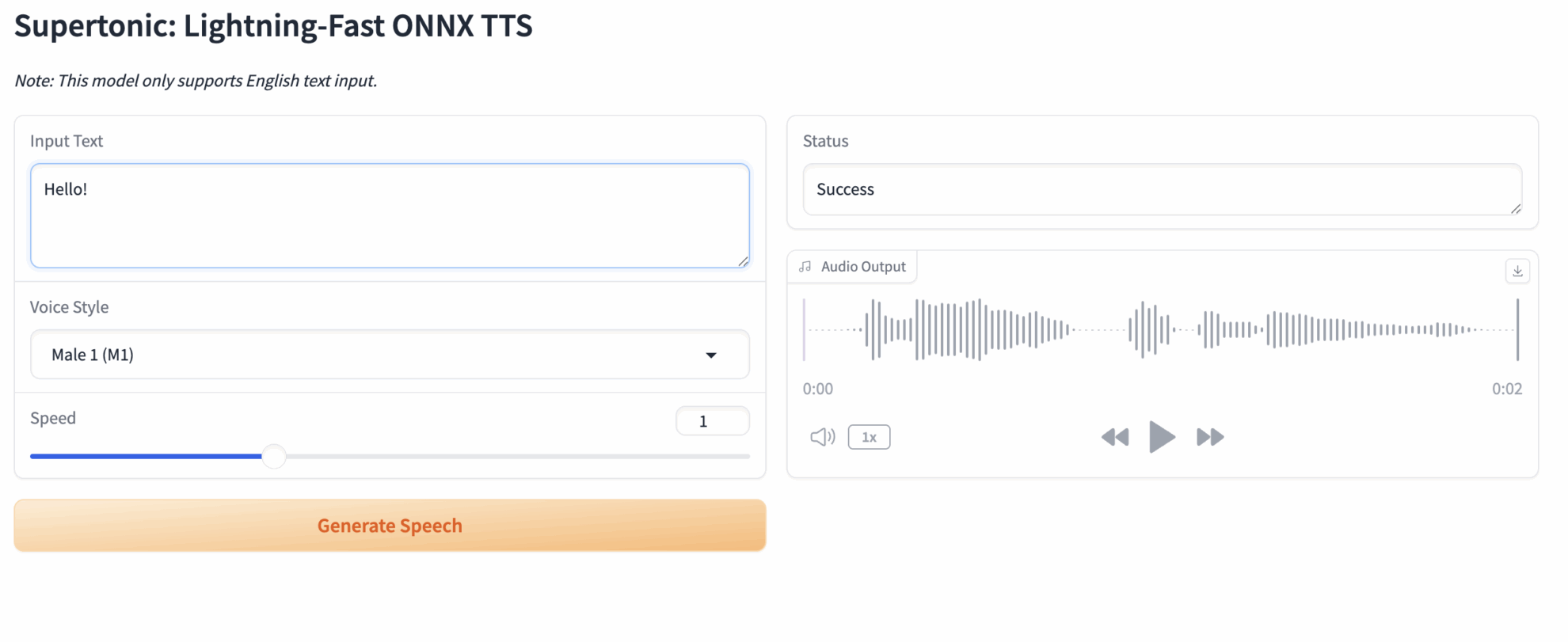

二、项目示例

三、运行步骤

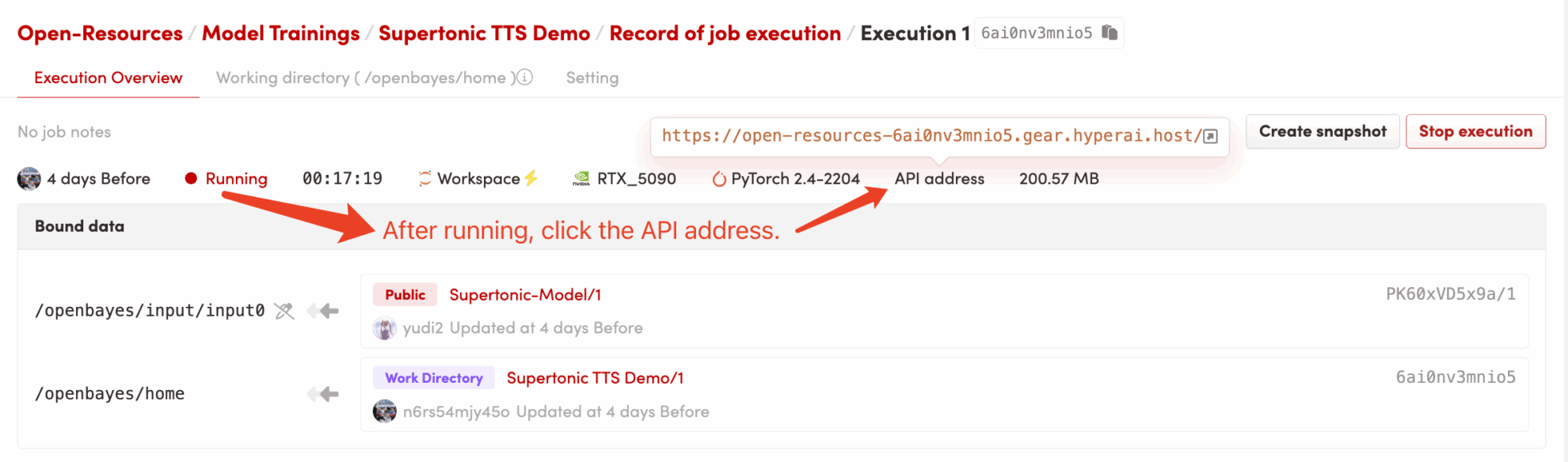

1. 启动容器后点击 API 地址进入 Web 界面

- 在 OpenBayes 控制台中克隆本公共教程。

- 启动容器:系统会自动为您分配 RTX 5090 资源。

- 等待启动:容器启动后,后台脚本

dependencies.sh会自动配置 CUDA 环境并加载模型。由于核心依赖已预装,此过程非常快,通常仅需 1-2 分钟。 - 访问应用:待容器状态变为「运行中」后,点击容器详情页右上角的「API 地址」按钮,即可打开 Gradio 网页界面。

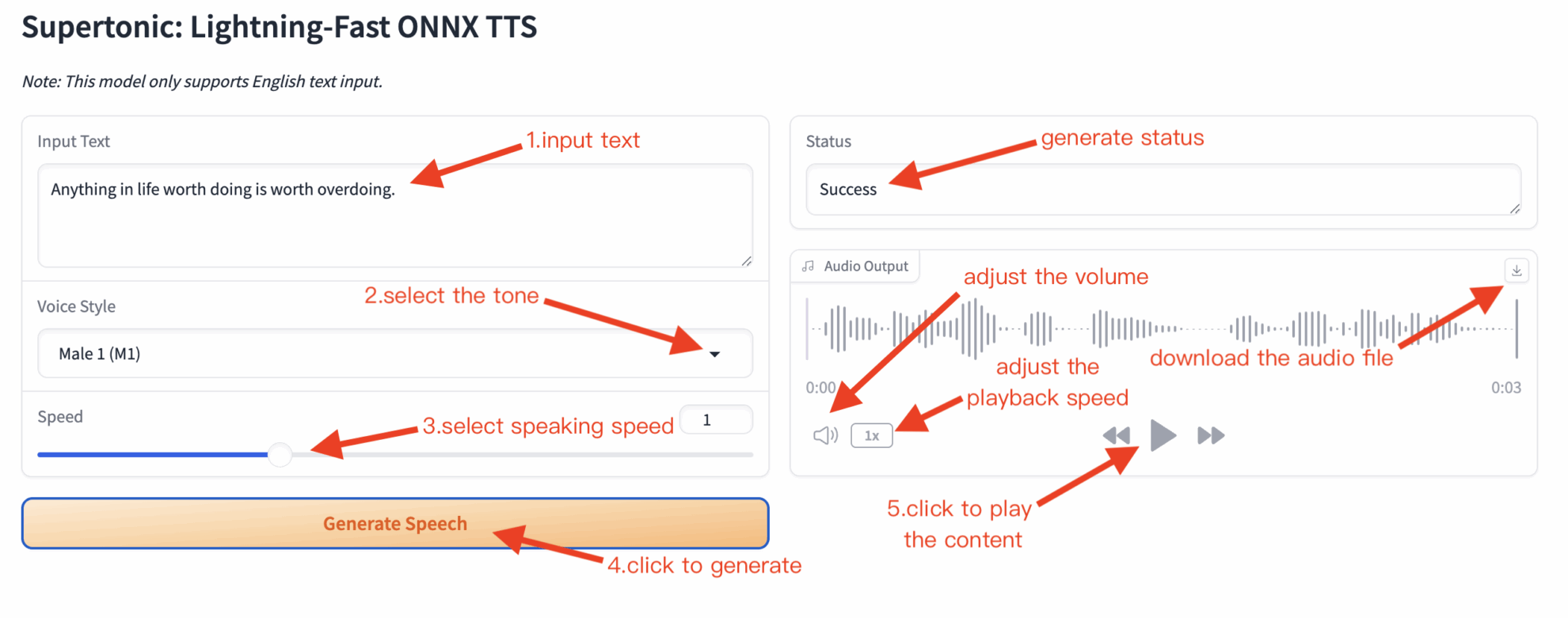

2. 在网页中输入文本并合成语音

若显示「Bad Gateway」,这表示服务正在启动中,由于模型加载需要时间,请等待约 1-2 分钟后刷新页面即可。

使用 Safari 浏览器时,音频可能无法直接播放,需要下载后进行播放。

进入网页后,您将看到全英文的交互界面。

基本使用步骤:

- Input Text:在左侧文本框中输入您想要合成的英文内容。 Example: Supertonic is a lightning-fast text-to-speech model.

- Voice Style:在下拉菜单中选择预设的风格(如

Male 1男声或Female 1女声)。 - Speed:拖动滑块调整语速,默认为 1.0 。

- Generate Speech:点击生成按钮。

- Audio Output:等待片刻,右侧播放器即会自动播放生成的音频,您也可以点击右上角下载按钮保存

.wav文件。

注意:首次点击生成时,ONNX Runtime 可能需要几秒钟进行 CUDA 初始化和图优化,后续的生成速度将会非常快。

四、交流探讨

🖌️ 如果大家看到优质项目,欢迎后台留言推荐!另外,我们还建立了教程交流群,欢迎小伙伴们扫码备注【SD 教程】入群探讨各类技术问题、分享应用效果↓

引用信息

@article{kim2025supertonic, title={SupertonicTTS: Towards Highly Efficient and Streamlined Text-to-Speech System}, author={Kim, Hyeongju and Yang, Jinhyeok and Yu, Yechan and Ji, Seunghun and Morton, Jacob and Bous, Malek and Lee, Sungjae}, journal={arXiv preprint arXiv:2503.23108}, year={2025}, url={[https://arxiv.org/abs/2503.23108](https://arxiv.org/abs/2503.23108)} } @article{kim2025larope,

title={Length-Aware Rotary Position Embedding for Text-Speech Alignment},

author={Kim, Hyeongju and Lee, Juheon and Yang, Jinhyeok and Morton, Jacob},

journal={arXiv preprint arXiv:2509.11084},

year={2025},

url={https://arxiv.org/abs/2509.11084}

}@article{kim2025spfm,

title={Training Flow Matching Models with Reliable Labels via Self-Purification},

author={Kim, Hyeongju and Yu, Yechan and Yi, June Young and Lee, Juheon},

journal={arXiv preprint arXiv:2509.19091},

year={2025},

url={https://arxiv.org/abs/2509.19091}

}